1 背景

近年,生産製造工程は主にロボットを使ったオートメーション化が進み,24 時間無人稼働する工場も増えてきている。しかし,MFP(複合機,Multi-functional Peripherals)に代表される精密機器の製造組立はロボット化が難しい領域で,まだまだ人間の手で行われていることが実際である。一方で,人材不足を起因とする人件費の高騰は不可避であり,生産コストへの悪影響が懸念される。

コニカミノルタを始め,各メーカーは貴重な人的リソースの有効活用に腐心し,製造組立現場では改善活動を間断なく進めている。具体的には,工場作業者が最も効率良く動くための,工程レイアウト設計や作業者動線解析,部材デリバリータイミング最適化などに取り組んでいる。

2 マレーシア工場の課題

Fig. 1は,コニカミノルタ製品群の中で,主にMFPの主力製品の生産を担っているマレーシア工場(KONICA MINOLTA BUSINESS TECHNOLOGIES [MALAYSIA] Sdn. Bhd.〈略称:BMMY〉)である。BMMYでは,他生産拠点と同様にQCやIEの手法を活用し生産性の改善を推進している。

IEとは,工程や作業の方法,作業にかかる時間などを科学的な手法に基づき細かく定量化し分析することで,ムリ・ムダ・ムラのない最適な方法を導き出す生産性を向上する手法である。複数あるIEの分析手法の中で工程改善に頻繁に使用されるのが時間分析法である。作業者の作業内容から決定する「標準時間」とストップウォッチ等で実際に作業に要した時間を計測する「実作業時間」を比較し,「標準時間」よりも「実作業時間」が大幅に多い生産性が低い工程を特定し改善する。

Fig. 1 Actual production at BMMY factory.

BMMY内でも生産性改善を推進するために,時間分析法に基づき「現状分析」「要因特定」「対策検討/投入」「効果測定」の改善サイクルを高速に回転させるのが理想である。「現状分析」と「効果測定」を行うためには,全行程の「実作業時間」を収集する必要がある。しかし,大量生産型のMFP製品は数百にも及ぶ工程に分割して組立を行っており,その多くが人の手で組立作業を行っているため,全行程の「実作業時間」を収集するのに多大な工数が必要となり,改善サイクルのボトルネックとなっている。

「現状分析」が完了した後に「要因特定」のための「作業内容解析」を実施する。計測された実作業時間から,直接作業(製品組立に必須な作業)と間接作業(直接作業に付随する作業:ゴミを捨てる,部品を袋から出す等)を切り分け,直接作業時間が規定された時間より多くかかっているのか,間接作業時間が多いのか等を検証することで,「要因特定」を行う。現状これらの検証は,分析担当者が対象工程を直接観察することで実現している。

生産拠点ではコスト改善や生産性改善の要求が強まっていく中,さらにコロナ禍で出勤率の制限がかかり,間接的な業務への人的リソースの配置が困難になっている。

リソース不足で改善のボトルネックとなっている「現状把握」「効果測定」「作業内容解析」を自動化することによって生産性のさらなる改善につなげたい。

3 骨格検出技術

上述の課題を解決するために,我々はコニカミノルタの保有する物体認識技術(FORXAI Recognition)を活用しシステムを構築した。Fig. 2はFORXAI Recognitionの出力結果の一例である。我々は特に,物体認識技術のうち骨格検出アルゴリズム1)を用いた。

Fig. 2 FORXAI Recognition can perform fast on low-resource edge devices.

Include algorithms such as

・ Pose detection and tracking of 2D skeletons from monocular cameras.

・ Attribute / Action recognition.

骨格検出アルゴリズムによって得られた骨格情報を,特定の個人に結び付ける必要がある。作業者が着用している衣服などの外観の色情報に着目し,ある時刻で骨格検出により得られた骨格情報から頭部,胴部,脚部の色情報を抽出した上で,次の時刻以降,各部位の色情報が近似する画像位置を特定することで作業者を追跡し,特定の個人に骨格情報を結び付けた。人物の色情報を抽出するために,先述の物体認識技術に含まれる属性認識アルゴリズムを適用し,色情報をラベルという形式で求めた。しかしながら,本稿では作業者の作業状態などを把握することを目的としているため,骨格検出アルゴリズムによって得られた骨格情報を基に直接各部位の画像上の輝度値を参照して色情報を計算した。Fig. 3は,骨格情報を基に抽出した色情報のサンプルである。頭,体,脚の各骨格点の色を抽出し,HAT,CLOTHES,PANTS の文字の色に反映させている。

Fig. 3 Sample result image of estimation.

Extracting color information of head, body and leg based on result

of pose estimation.

加えて,背景や他者と判別可能,かつ輝度値が一定の範囲内で撮像できる色の帽子やビブスを現場の作業者に着用させ追跡可能な対象として用いた。このようにして得られた追跡のための色情報,およびその算出に用いる骨格情報をCSV形式でファイル出力し,データ分析へと移行する。現在,このような骨格検出および色情報の抽出のプロセスをウェブアプリケーション上で実行するためのクラウド環境を構築することで,動画を取得後,即時に解析を実行できる手段を用意した。今後も解析対象工程の拡大を見据えてシステム開発を継続していく予定である。

4 データ分析

今回は物体認識技術によって個人を特定した骨格情報を活用して,以下の2つの分析を実施した。

4. 1 作業者の移動距離の測定

マレーシアのMFPの骨格組み立て工程では,自動搬送機〈略称:AGV〉上の部品に対して作業者が流れ作業で組み立てを行う。そのため,作業者はAGVで流れてくる部品に対して歩き回りながら組み立て作業を実施している。そこで,作業者の移動距離を定量化することで,無駄に動いている時間帯や,作業者ごとの移動距離を比較することで無駄な動きを定量化できると考えた。

本取り組みにおいては,対象作業者がユニーク色のイエローヘルメットを装着し組み立て作業を実施・撮影し,FORXAI Recognitionを用いて人の各関節点の画像位置(pixel位置)と色情報をCSV形式で出力した。得られたCSVファイルから,イエローヘルメットをかぶっている骨格を特定し,骨格の軌跡を描き,移動距離を算出した。移動距離は,画像の中の既知の距離情報を基にしてピクセルから距離情報への変換式を作成し出力した。

また,画像の奥行によってピクセルと距離情報が違う場合は,場所によって使う変換式を変えることで正確な距離情報を算出した。

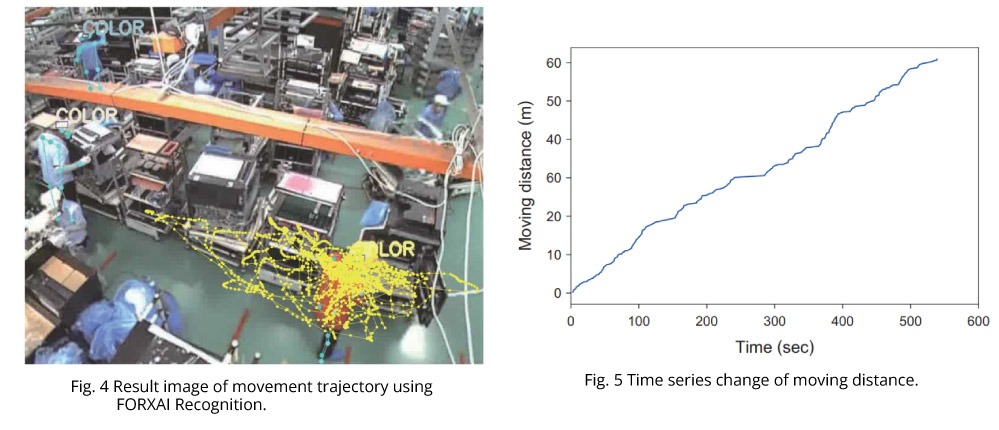

Fig. 4 は10分間の動画を解析し特定した対象作業者の軌跡である。Fig. 5 はその時の対象作業者の総移動距離を時系列で示したものである。Fig. 4 では,対象者は10分間の間に数回画面左奥の方まで移動していることが分かった。また,Fig. 5 では,10分間で対象作業者が 61 m移動していることが分かった。さらに,どのタイミングで多く移動しているかも把握でき,そのときの動作を特定することで作業改善を行うことが可能である。作業者ごとの移動距離の定量化を行うことで,作業者に合わせた作業改善を実施することが期待できる。

4. 2 作業者の間接作業割合の定量化

これまでは人が直接観察することで確認していた直接作業時間と間接作業時間の特定の自動化に取り組んだ。

本取り組みにおいては,対象作業者がユニーク色の赤服を着用し組み立て作業を実施・撮影し,個人を特定した骨格情報を取得した。その後,直接作業を0,間接作業を 1としてアノテーションを実施し,さらには骨格情報に対して相対距離や移動速度を算出するなどの特徴量エンジニアリングを行った。作成したデータを学習データと検証データに分け,複数の分類モデルを作成しArea Under the Curve(AUC)で評価を行った。

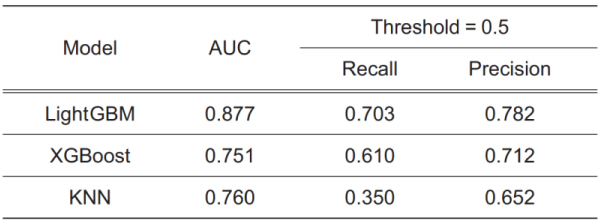

Table 1 は,今回比較した3つのモデルのAUCと,閾値を0.5としたときの再現率と適合率の結果を示している。今回のケースでは,AUC,再現率,適合率が全て一番良かったLightGBMを採用した。

Table 1 Comparison of three model accuracy

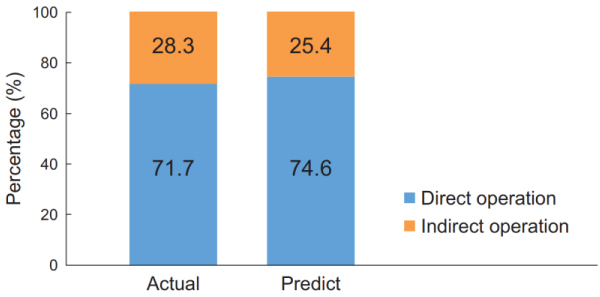

Fig. 6 のように,直接作業と間接作業の比率を確認すると,作業者が実際(Actual)に28.3 %の間接作業を実施していたのに対して,予測結果(Predict)では25.4 %が間接作業を実施していたと判断しており,高い精度で作業者の行動を判別できていることが分かる。また,動画を確認しても,モデルが間接作業と判断したタイミングにおいては,Fig. 7 のように,作業用の部品を袋から取り出すなど,実際に間接作業を実施していたことを確認できた。

Fig. 6 Comparison of indirect operation ratio.

Fig. 7 Pick up image of indirect operation.

本結果により,対象作業者の直接/間接作業を正確に検出することで,製造現場の改善担当者は現場に張り付いていなくても,出力された結果から対策を実施するべきかを早期に判断できる。また,間接作業が想定よりも多いタイミングを本モデルで検出し切り出して動画として改善担当者に提供することで,対策検討に早期につなげることができる。

5 まとめ

今回の活動による定量化や可視化の成果を,BMMYの実際の組立生産現場で現場改善活動に用いて,フィードバックを受けることで,より有用な定量値や見せ方を目指す活動を始めている。すでに複数作業者の連携のよしあしを確認したいという意見も聞いており,技術開発の余地は大いにあるが,それだけポテンシャルの高い技術と言える。

今後は社内の国内外拠点へ展開することで,現場改善活動サイクルを早めることによる生産性アップに貢献するだけではなく,FORXAIソリューションの1つとして,社外ビジネスへの展開も期待できる。